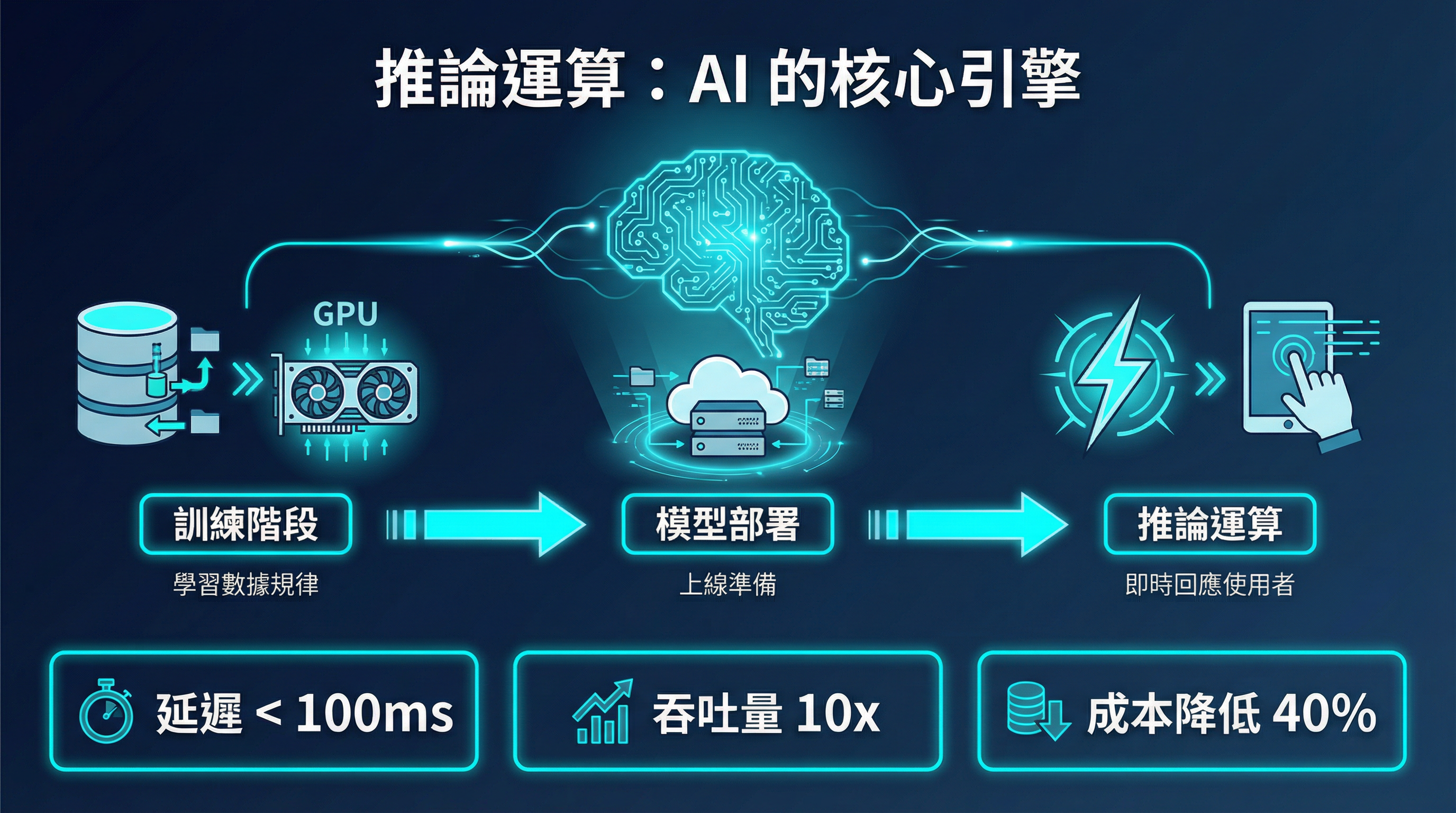

什麼是 AI 推論運算(Inference)?與模型訓練有何不同?

在探討 2026 年的 AI 發展趨勢時,我們必須先釐清一個核心概念:AI 推論運算(Inference)。簡單來說,如果把 AI 模型比喻為一個學生,「訓練(Training)」就是學生在學校裡苦讀、吸收大量知識的過程;而「推論(Inference)」則是學生畢業後進入職場,實際運用所學知識來解決問題、回答客戶提問的階段。

許多企業在初期導入 AI 時,往往將資源集中在模型訓練上,卻忽略了當 AI 服務正式上線、面對數以萬計的使用者時,真正消耗算力與成本的是推論運算。根據 Gartner 的預測,2026 年企業在「AI 推理」的投資將正式超越模型訓練,迎來歷史性的黃金交叉。

### 訓練與推論的硬體需求差異

這兩者對硬體的需求截然不同。訓練階段需要處理海量數據,因此高度依賴具備強大平行運算能力的 GPU 叢集;而推論階段則更看重低延遲(Low Latency)與高吞吐量(High Throughput),要求系統能在毫秒級的時間內給出精準回應。這也是為什麼 NVIDIA 在 GTC 2026 大會上,特別針對推論市場推出了 Vera Rubin 平台與 Groq 3 LPU 等專用硬體。

| 比較項目 | AI 模型訓練(Training) | AI 推論運算(Inference) |

|---|---|---|

| 核心目標 | 讓模型從海量數據中學習規律與特徵 | 將訓練好的模型應用於實際場景,產生預測或解答 |

| 運算特徵 | 批次處理、耗時長、計算密集 | 即時回應、低延遲、吞吐量密集 |

| 硬體需求 | 大量高階 GPU 並行運算(如 H100, Blackwell) | 專用推論晶片(LPU, NPU)、高效能 CPU 或邊緣運算設備 |

| 企業成本佔比 | 初期建置成本高,屬一次性或週期性支出 | 隨用戶量與使用頻率線性增長,屬持續性營運支出 |

2026 年 AI 推論市場的 3 大關鍵趨勢

隨著生成式 AI 與代理式 AI(Agentic AI)的普及,企業對推論算力的需求呈現爆發性成長。以下是我們觀察到的 2026 年三大關鍵趨勢:

### 1. 資金從雲端流向邊緣運算(Edge Inference)

過去,多數的 AI 推論都在雲端資料中心進行。然而,隨著雲端運算成本的攀升以及對資料隱私、即時性的要求提高,越來越多企業開始將推論任務轉移到邊緣設備(如本地伺服器、工業電腦甚至終端裝置)上。Akamai 攜手 NVIDIA 推出「推理雲(Inference Cloud)」,以及台積電 2nm 製程對邊緣 NPU 的支援,都印證了這個趨勢。邊緣推論不僅能大幅降低雲端傳輸的延遲,更能確保敏感數據不離開企業防火牆。

### 2. 專用推論晶片(LPU/NPU)崛起

面對龐大的推論需求,傳統的 GPU 架構在成本與能效比上已不再是唯一解方。NVIDIA 在 GTC 2026 發表的 Groq 3 LPU(Language Processing Unit)就是專為低延遲推論設計的利器。單一機櫃整合 256 顆 Groq 3 LPU,具備高達 40 PB/s 的頻寬,與 Vera Rubin 平台搭配使用時,可實現每瓦吞吐量提升 35 倍的驚人效能。這意味著企業能以更低的電力成本,服務更多的 AI 用戶。

### 3. 代理式 AI(Agentic AI)推升算力需求

2026 年被譽為「AI Agent 元年」。與過去一問一答的聊天機器人不同,代理式 AI 能夠自主規劃任務、調用工具並執行多步驟操作。這種複雜的運作模式需要模型在背景進行大量的連續推論與自我驗證,對推論算力的需求呈指數級增長。NVIDIA 推出的 Vera CPU 與 Rubin GPU 架構,正是為了支撐這種「兆參數模型」與「百萬 token 上下文」的代理式 AI 應用而生。

企業如何佈局 AI 推論基礎建設?避坑指南與實務建議

許多企業在導入 AI 時,最常犯的錯誤就是低估了上線後的推論成本。當內部員工或外部客戶開始頻繁使用 AI 服務時,暴增的 API 呼叫費用往往讓企業吃不消。以下是我們給企業的實務建議:

* 精算推論成本(Cost per Token):在選擇 AI 模型與部署方案時,不能只看模型的聰明程度,更要精算每個 token 的生成成本。對於高頻繁、低複雜度的任務,應優先考慮使用較小型的開源模型(如 Llama 3 8B)並進行地端部署,而非一味依賴昂貴的雲端大模型 API。

* 採用混合雲或地端推論架構:對於涉及客戶個資、商業機密的核心業務,強烈建議採用地端私有推論架構。這不僅符合資安合規要求,長期來看也能有效控制營運成本。

* 導入 AI 代理管理平台:隨著企業內部部署越來越多的 AI 代理,如何有效管理這些「數位員工」的權限與算力資源成為新挑戰。企業應評估導入如 NVIDIA NemoClaw 這類具備受控沙盒環境的企業級 AI 框架,確保推論過程的安全與可控。

| 企業常見痛點 | AI 推論優化解決方案 | 預期效益 |

|---|---|---|

| 雲端 API 費用失控 | 將高頻任務轉移至地端開源模型進行本地推論 | 降低 60%-80% 的長期營運成本 |

| 回應延遲導致體驗不佳 | 導入邊緣推論(Edge Inference)架構 | 回應時間縮短至毫秒級,提升滿意度 |

| 資料隱私與合規風險 | 建置企業專屬的私有推論伺服器與受控沙盒 | 確保敏感數據不外流,符合 ISO 27001 等規範 |

戰國策集團如何協助企業優化 AI 推論架構?

在 AI 轉型的道路上,選擇正確的基礎建設與推論架構,是決定專案成敗的關鍵。戰國策集團憑藉 25 年的企業資訊服務經驗,為企業提供從顧問諮詢到系統落地的全方位 AI 解決方案。

我們深知企業在面對龐大推論成本時的痛點。透過我們的「企業專屬 AI 系統」建置服務,我們能協助企業評估最適合的硬體架構(如 NVIDIA RTX PRO 工作站或邊緣運算設備),並將開源模型進行微調與地端部署。這不僅能確保企業資料的絕對安全,更能將推論成本控制在可預期的範圍內,讓 AI 真正成為提升企業競爭力的得力助手,而非沉重的財務負擔。

準備好為您的企業打造高效、安全的 AI 推論架構了嗎?

別讓高昂的雲端推論成本阻礙了您的 AI 轉型之路。戰國策集團提供專業的 AI 地端部署與算力優化顧問服務,為您量身打造最具成本效益的企業級 AI 解決方案。

探索更多 AI.com.tw 服務

想讓 AI 真正落地到你的企業營運中嗎?

AI.com.tw 提供從顧問諮詢、系統開發到員工培訓的一站式服務,協助企業快速導入 AI、提升競爭力。

免費諮詢專線:0800-003-191

LINE 即時諮詢:@119m

Email:ceo@ai.com.tw